디스코드(Discord), 정말 안전한가요? 뉴저지 소송으로 본 아동 보호 현실

아이들이 쓰는 디스코드, 정말 믿어도 될까요? 최근 뉴저지 주가 디스코드를 상대로 소송을 제기하면서, 그 안전 기능의 실효성에 의문이 제기되고 있습니다.

안녕하세요, 요즘 아이들이 많이 쓰는 디스코드에 대해 걱정하는 부모님들 많으시죠? 저도 평소에는 단순한 채팅 앱 정도로 생각했는데, 최근 뉴저지 주 법무장관이 디스코드를 상대로 아동 보호 미흡을 이유로 소송을 제기했다는 뉴스를 보고 깜짝 놀랐습니다. 단순한 오해일 수도 있겠지만, 실제로 디스코드의 연령 확인 시스템, 메시지 필터링 기능이 생각보다 허술하다는 사실이 속속 드러나고 있어요. 오늘은 그 소송 내용을 중심으로 디스코드 아동 안전의 현실을 냉정하게 짚어보겠습니다.

목차

뉴저지 소송 개요와 주요 쟁점

2025년 4월, 뉴저지 주 법무장관 매튜 플랫킨은 디스코드를 상대로 소비자 사기법(NJCFA) 위반 소송을 제기했습니다. 그는 디스코드가 아동 안전 기능을 과장 광고했으며, 특히 성범죄자 및 유해 콘텐츠로부터 아이들을 제대로 보호하지 못했다고 주장했죠. 이 소송은 단순한 기술적 결함이 아닌, 플랫폼 전반의 구조적 문제를 지적하고 있다는 점에서 중요성이 큽니다.

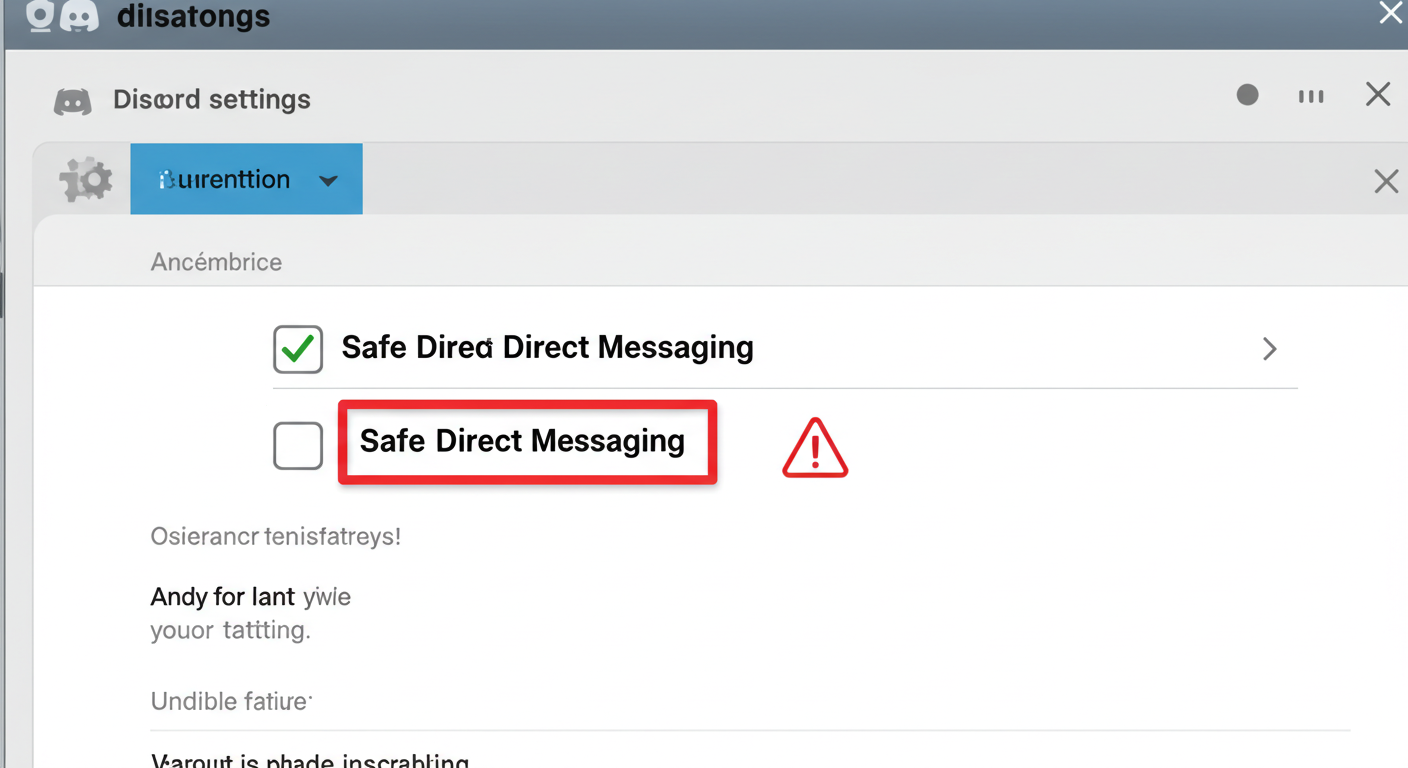

'안전한 메시지' 기능, 정말 안전했을까?

| 기능명 | 문제점 |

|---|---|

| Safe Direct Messaging | 기본 설정인 "My friends are nice" 때문에 친구 간 메시지는 필터링되지 않아 유해 콘텐츠가 필터 없이 노출됨 |

| 콘텐츠 필터링 | 이미지나 텍스트에 대한 실질적 차단 효과 부족, CSAM(아동 성착취물)까지 필터링 안 되는 사례 존재 |

디스코드의 연령 확인 시스템의 허점

디스코드는 사용자가 생년월일만 입력하면 가입이 가능한 구조로 되어 있어요. 이론상 만 13세 이상만 사용 가능하지만, 실질적인 검증은 사실상 없습니다. 일부 국가는 얼굴 인식, 신분증 확인 등의 강화 조치를 시범 도입했지만, 아직 전체적으로 적용되진 않았죠.

- 생년월일 입력만으로 접근 가능 (나이 속이기 쉬움)

- 얼굴 스캔 또는 신분증 인증은 선택적, 국가별로 제한적 시행

- 보호자 알림 기능은 제한적 기능만 존재

소송의 법적 근거: NJCFA란?

이번 소송에서 핵심적인 법적 근거가 된 건 뉴저지 소비자 사기법(NJCFA)입니다. 이 법은 기업이 소비자를 기만하는 행위를 금지하며, 위반 시 민사 처벌 및 수익 환수 조치를 받을 수 있게 규정하고 있어요. 디스코드는 자사의 ‘안전한 메시지 기능’을 광고했지만, 실제로는 보호가 이뤄지지 않았다는 점에서 기만적 마케팅이라는 비판을 받습니다.

소송에서는 다음과 같은 조치를 요구하고 있어요.

- 기만적 표현에 대한 사용 금지 명령

- 민사 벌금 부과 및 과거 수익 환수 조치

- 뉴저지 사용자에 대한 환불 또는 보상 명령

디스코드의 입장과 반박

| 디스코드 주장 | 검증 결과 및 비판 |

|---|---|

| 2023년 Family Center, Teen Safety Assist 도입 | 기능은 있으나 부모 통제력이 제한적이며 실시간 모니터링 어려움 |

| 2025년 아동 안전 오픈소스 도구 개발(Roost) | 긍정적 시도이나 실질적 확산 및 성능 검증은 미비 |

| 2017년 대비 보안 기능 개선 | 소송은 과거 설정에 집중되었지만 현재 문제도 여전하다는 지적 존재 |

부모가 알아야 할 디스코드 사용 주의사항

- 아이가 사용하는 디스코드 계정은 반드시 부모가 함께 설정

- 안전한 메시지 필터링 기능은 수동으로 설정해야 함

- 친구 추가 및 초대 링크 수락은 부모의 승인이 필요

- 이상 행동이 포착되면 즉시 신고 기능 활용 및 계정 정지 요청

공식적으로는 13세 미만은 가입할 수 없습니다. 하지만 생년월일 입력만으로 인증이 이뤄지기 때문에 실제로는 미취학 아동도 가입하는 사례가 있습니다.

이 설정은 친구로 등록된 사용자의 메시지를 스캔하지 않기 때문에, 아동이 이미 유해한 인물과 연결돼 있을 경우 아무런 보호 장치 없이 노출됩니다.

현재 텍스트 필터나 이미지 감지 기능은 제한적입니다. 일부 CSAM 콘텐츠나 폭력적인 이미지가 필터링되지 않고 전달될 수 있습니다.

2023년 이후 Family Center 기능이 도입되어 일부 활동 내역을 확인할 수 있지만, 채팅 내용까지 확인하거나 직접 통제하긴 어렵습니다.

즉시 해당 계정 신고 및 차단 기능을 사용하고, 필요 시 디스코드 고객센터나 경찰 사이버 범죄 대응팀에 문의하세요.

가능은 하지만 부모의 적극적인 모니터링과 계정 설정이 꼭 필요합니다. 특히 청소년 자녀의 경우, 사용 시간과 채팅 내용을 꾸준히 점검해야 안전하게 사용할 수 있습니다.

디스코드는 분명 매력적인 커뮤니케이션 플랫폼입니다. 하지만 아동과 청소년 사용자에게는 여전히 많은 위험이 도사리고 있죠. 이번 뉴저지 주의 소송은 단순한 기술 이슈가 아니라, 우리가 '디지털에서 아이들을 어떻게 지킬 것인가'에 대한 중요한 질문을 던집니다. 우리 아이가 디지털 세상에서 길을 잃지 않도록, 부모와 사회가 함께 지켜보는 눈이 되어줘야 할 때입니다. 여러분은 어떻게 생각하시나요? 댓글로 의견 나눠주세요!

'라이프코드' 카테고리의 다른 글

| OpenAI, 1,500억 달러로 날아오를까? AI 혁신의 판을 뒤흔드는 자금 조달 (3) | 2025.04.27 |

|---|---|

| 2025년 AI 음성 비서 비교: 퍼플렉시티 vs 시리, 구글 어시스턴트, 빅스비 (3) | 2025.04.25 |

| AI끼리 협업한다, Google A2A 프로토콜 (1) | 2025.04.16 |

| ChatGPT 메모리 업데이트 2025: 오픈AI의 새로운 기능 완벽 분석 🌟 (2) | 2025.04.11 |

| 2025년 Google 사이버 보안 AI 모델 Sec-Gemini v1 발표! (0) | 2025.04.10 |